Pendant la majeure partie des 200 ans d’histoire de la photographie, la modification d’une photo de manière convaincante nécessitait soit une chambre noire, une certaine expertise de Photoshop ou, au minimum, une main ferme avec des ciseaux et de la colle. Mardi, OpenAI a publié un outil qui réduit le processus à la saisie d’une phrase.

Ce n’est pas la première entreprise à le faire. Alors qu’OpenAI avait un modèle d’édition d’images conversationnelles en préparation depuis GPT-4o en 2024, Google a battu OpenAI sur le marché en mars avec un prototype public, puis l’a affiné en un modèle populaire appelé modèle d’image Nano Banana (et Nano Banana Pro). La réponse enthousiaste au modèle d’édition d’images de Google dans la communauté de l’IA a attiré l’attention d’OpenAI.

Le nouveau GPT Image 1.5 d’OpenAI est un modèle de synthèse d’images d’IA qui générerait des images jusqu’à quatre fois plus rapidement que son prédécesseur et coûterait environ 20 % de moins via l’API. Le modèle a été déployé mardi auprès de tous les utilisateurs de ChatGPT et représente une nouvelle étape vers la transformation d’images photoréalistes en un processus simple qui ne nécessite aucune compétence visuelle particulière.

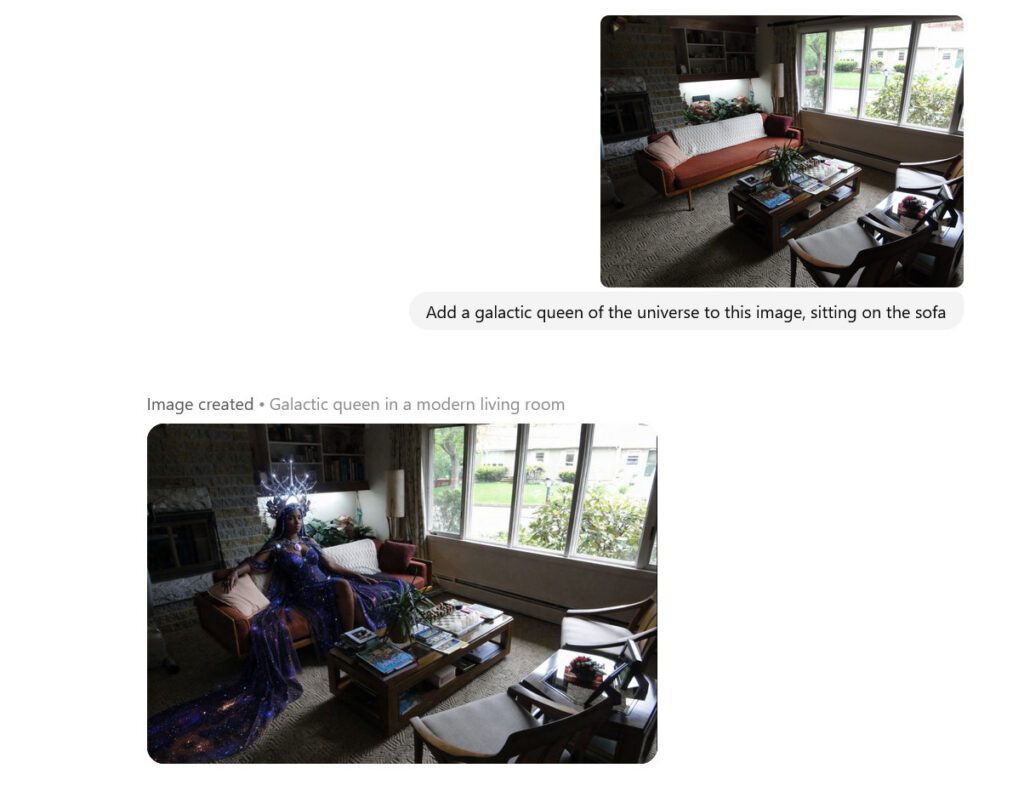

La « Reine Galactique de l’Univers » ajoutée à une photo d’une pièce avec un canapé en utilisant l’image GPT 1.5 dans ChatGPT.

GPT Image 1.5 est remarquable car il s’agit d’un modèle d’image « multimodal natif », ce qui signifie que la génération d’images se produit au sein du même réseau neuronal qui traite les invites linguistiques. (En revanche, DALL-E 3, un ancien générateur d’images OpenAI précédemment intégré à ChatGPT, utilisait une technique différente appelée diffusion pour générer des images.)

Ce type de modèle plus récent, que nous avons abordé plus en détail en mars, traite les images et le texte comme le même genre de choses : des morceaux de données appelés « jetons » à prédire, des modèles à compléter. Si vous téléchargez une photo de votre père et tapez « mettez-le en smoking lors d’un mariage », le modèle traite vos mots et les pixels de l’image dans un espace unifié, puis génère de nouveaux pixels de la même manière qu’il produirait le mot suivant dans une phrase.

Grâce à cette technique, GPT Image 1.5 peut modifier plus facilement la réalité visuelle que les modèles d’images d’IA précédents, en modifiant la pose ou la position d’une personne, ou en restituant une scène sous un angle légèrement différent, avec plus ou moins de succès. Il peut également supprimer des objets, modifier les styles visuels, ajuster les vêtements et affiner des zones spécifiques tout en préservant la ressemblance du visage lors des modifications successives. Vous pouvez discuter avec le modèle IA d’une photographie, l’affiner et la réviser, de la même manière que vous pourriez rédiger un brouillon d’e-mail dans ChatGPT.